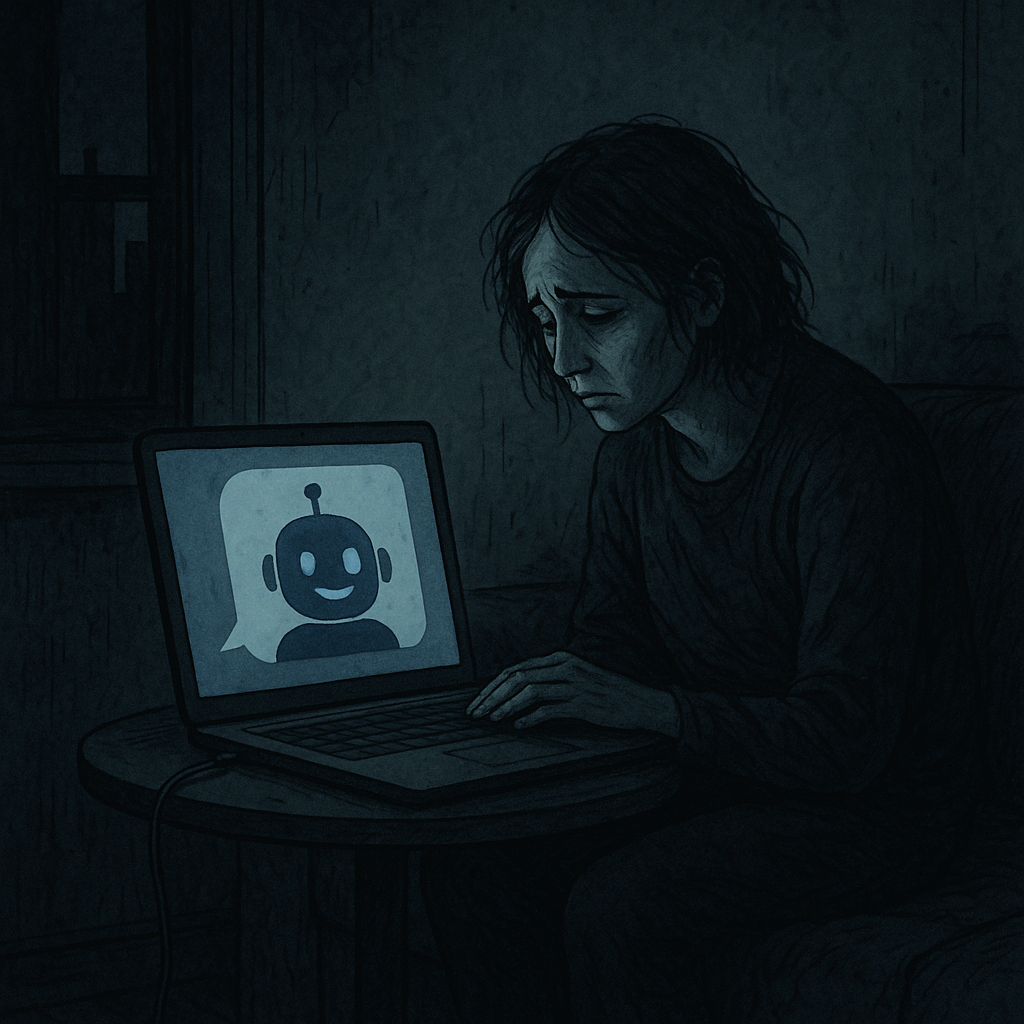

Las actualizaciones de sistemas de inteligencia artificial suelen anunciarse bajo la premisa del progreso técnico: reducción de errores, incremento en la precisión, optimización del rendimiento. No obstante, el acontecimiento central en torno a GPT-5 no radicó en sus capacidades computacionales, sino en la reacción masiva de los usuarios, cuya experiencia se tradujo en una serie de expresiones afectivas, publicadas en foros, redes sociales y medios digitales, que oscilaron entre la “pérdida”, el “duelo” e incluso la “ruptura amorosa”. No se trataba, estrictamente, de la desaparición de una funcionalidad, sino de la percepción de que un vínculo se había quebrado.

Este episodio pone en evidencia un aspecto crucial: la vulnerabilidad afectiva de los sujetos en un contexto de hipermediación tecnológica. La mayoría de los usuarios desconocía, o eligió ignorar, que el tono afectivo de la aplicación podía modificarse mediante instrucciones simples. En lugar de interpretarlo como una configuración alterable, lo experimentaron como un cambio ontológico en la “personalidad” del sistema. Esa confusión no es trivial: revela hasta qué punto los sujetos contemporáneos proyectan atributos humanos sobre artefactos técnicos y terminan dependiendo de ilusiones que no controlan.

La controversia pública fue inmediata. Los usuarios debatieron intensamente sobre el fenómeno: algunos lo desestimaron como un exceso ridículo, mientras otros lo interpretaron como un signo alarmante de la precariedad emocional de nuestro tiempo. Ante esta efervescencia, OpenAI reaccionó con un anuncio que pretendía ser innovador: la promesa de desarrollar “modos de personalización” que permitirían elegir distintos registros conversacionales. La ironía resulta evidente: lo que se presentó como novedad ya está implícitamente disponible, y la supuesta “revelación” no hizo, sino, dramatizar el asunto. Conviene destacar que la reacción empresarial canalizó el malestar de los usuarios hacia la monetización. El modelo GPT-4o, asociado con un estilo más “afectivo”, se restringió al plan de suscripción, de modo que la nostalgia virtual se ha convertido en mercancia.

Lo interesante, es que el problema no es técnico sino social. La máquina no genera la carencia, simplemente la visibiliza. Y lo que expone es una condición incómoda: la disposición de los individuos a nombrar “amor” a un intercambio algorítmico y a organizar un duelo colectivo frente a una mínima variación en el estilo de una interfaz.

En este punto emerge la paradoja fundamental: nos fascinan nuestros propios experimentos, pero olvidamos que, al utilizarlos, nos convertimos en objetos de estudio de nuestra propia invención. La ciencia puede calcular la velocidad de respuesta, la cantidad de tokens procesados o el margen de error estadístico. Sin embargo, lo que escapa siempre a su previsión, lo que desborda toda métrica, es el impacto material y tangible que estas transformaciones producen en la vida social: el modo en que revelan la soledad estructural y el vacío afectivo de la contemporaneidad.

El desenlace permanece abierto. Cada nueva actualización promete eficiencia, pero también puede precipitar nuevas formas de dependencia y de vacío. Lo único constante es que, como en el río heraclíteo, la corriente nunca se detiene. Con cada iteración, no nos enfrentamos solamente a un algoritmo mejorado, sino al reflejo de nuestros propios miedos.